|

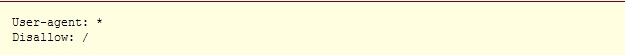

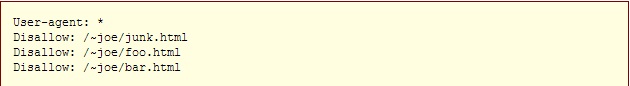

مقالات سئو مقالات سئو ربات های وب (که به نام های سرگردانان وب، خزندگان یا عنکبوت ها نیز شناخته می شوند) به برنامه هایی می گویند که به صورت خودکار سراسر وب را می گردند و جستجو می کنند. موتورهای جستجویی نظیر گوگل از آنها برای محتوای درون وب استفاده می کنند و اسپمرها برای به دست آوردن ایمیل آدرس ها. آنها کارایی های بی شماری دارد. توضیحات واضح در مورد فایل robots.txt دارندگان سایت ها از robots.txt جهت معرفی ساختار سایتشان به ربات های سراسر وب استفاده می کنند. یک مثال در ارتباط با چگونگی کارکرد این فایل: یک ربات جستجوگر مثل ربات گوگل قصد ورود به سایت شما را دارد تا موارد مورد نظرش چون خطاها، صفحات، محتوا، تصاویر و غیره را ایندکس کند. در صورتی که صفحه ورودی شما http://www.example.com/welcome.html باشد، ربات مورد نظر ابتدا و پیش از هر نوع بررسی سایت شما نشانی http://www.example.com/robots.txt را چک خواهد کرد. و در نهایت به این دستورات بر خواهد خورد:

عبارت User-agent: * به معنای این است که این سایت و این دستور برای هم? ربات ها یکسان است. و قسمت Disallow: / حاوی این پیام است که هیچ رباتی نباید هیچ قسمتی از این سایت را بررسی و مشاهده نماید. دو نوع نگرش نسبت به استفاده کنندگان از robots.txt وجود دارد: 1. ربات ها می توانند robots.txt شما را نادیده بگیرند! به خصوص آنکه ربات های مخرب، کارشان اسکن نمودن سراسر وب برای یافتن نقص های امنیتی، ایمیل آدرس ها و غیره است، کوچکترین توجهی به محتویات robots.txt ندارند. 2. فایل robots.txt یک فایل در دسترس عموم می باشد. هرکسی می تواند ببیند که شما کدام قسمت را تمایل ندارید که ربات های دیگر ببینند. *پس برای مخفی نمودن اطلاعاتتان با استفاده از robots.txt تلاش نکنید. نحو? ساخت یک فایل robots.txt کجا آن را قرار دهیم؟ پاسخ کوتاه: در بالاترین سطح دایرکتوری سرور سایتتان پاسخ کامل: زمانیکه یک روبات به دنبال فایل robots.txt برای نشانی URL شما می گردد، به دنبال اولین اسلش پس از اکستنشن شما می رود و به صورت اتوماتیک عبارت robots.txt را قرار می دهد. برای مثال اگر داشته باشیم: http://www.example.com/shop/index.html، ربات مورد نظر /shop/index.html را حذف نموده و /robots.txt را جایگزین و در انتهای URL قرار می دهد. به همین خاطر شما به عنوان دارنده سایت می بایست این فایل را در مکان صحیح و جایی قرار دهید که در نتایج جستجو دیده شده و عمل نماید. معمولا این فایل را در جایی مشابه همان صفحه اصلی سایت (index.html) یا همان صفح? به اصطلاح خوشامدگویی قرار می دهند. *فراموش نکنید که تمام حروف این فایل کوچک نوشته می شوند: صحیح: robots.txt ؛ غلط: Robots.TXT چه چیزی در آن بنویسیم؟ فایل robots.txt یک فایل متنی است که از یک یا تعداد بیشتری از دستورات ساخته شده است. به صورت معمول شامل یک دستور شبیه به این می شود:

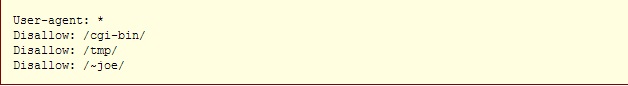

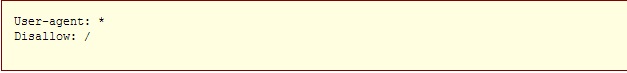

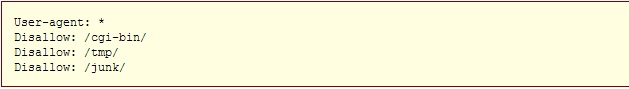

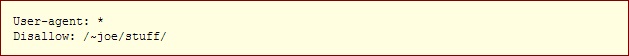

در مثال فوق شاهد 3 دایرکتوری محروم شده هستید که با استفاده از این 3 دستور، پیامی به ربات های سراسر وب ارسال می کند که به معنی عدم دسترسی ایشان به فایل های مشخص شده است. توجه داشته باشید که برای محروم نمودن ربات ها به یک URL خاص، باید در هر خط مجزا یک دستور جدید را وارد نمایید. شما نمی توانید دستور Disallow: /cgi-bin/ /tmp/ را در یک خط وارد نمایید. همچنین نباید در مقابل یک دستور، خط را خالی بگذارید چراکه برای ربات این تصور می شود که دستور مورد نظر برای تمام وبسایت شما قابل اجرا است. ضمنا شما نمی توانید به صورت منظم و نامنظم دستورات داخل فایل را با یکدیگر ادغام نمایید. برای مثال علامت "*" در فیلد User-agent به معنای آن است که دستورات وارد شده در مقابل این عبارت برای تمامی ربات ها لازم الاجراست. به طور مشخص و عینی شما نمی توانید دستوراتی چون User-agent: *bot*", "Disallow: /tmp/*" or "Disallow: *.gif را در کنار همدیگر وارد نمایید. بررسی دقیق نمایید که چه چیزهایی را نمی خواهید ربات ها ببینند. هرچیزی را که نمی خواهید آنها ببینند را به راحتی می توانید از دیدشان مخفی کنید. به مثال های زیر توجه بفرمایید: خط فرمان به تمام ربات ها برای عدم دسترسی به کل سایت شما

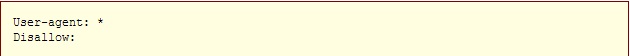

خط فرمان به تمام ربات ها برای دسترسی به کل سایت شما

برای اجرای دستور فوق همچنین می توانید یک فایل robots.txt بدون متن بسازید و هیچوقت به سراغش نروید. خط فرمان به تمام ربات ها برای عدم دسترسی به بخشی از سایت شما

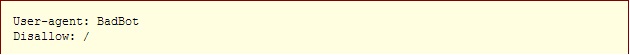

خط فرمان به یک ربات خاص برای عدم دسترسی اش به کل سایت (برای مثال نام ربات "BadBot" است)

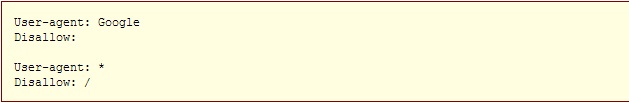

خط فرمان به تنها یک ربات خاص جهت دسترسی به کل سایت شما و عدم دسترسی سایر ربات ها:

خط فرمان به تمام ربات ها برای عدم دسترسی به تمام فایل ها به جز برخی از آنها:

یا برای مشخص نمودن دقیق یک نشانی و یا فایل می توانید از این دستورات استفاده کنید و نشانی دقیق را در باکس robots.txt وارد نمایید.

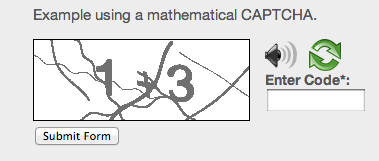

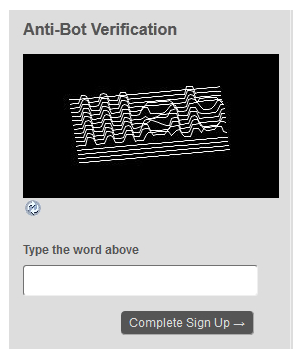

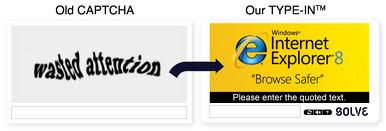

حتما تا بحال هنگام فعالیت های اینترنتی مانند تبادلات مالی آنلاین ، ترافیک وب سایت ها و موتورهای جستجو ، نظرسنجی های آنلاین ، ثبت نام های آنلاین ، سرویس های ایمیل رایگان و بسیاری دیگر از چنین موارد با کادری روبرو شده اید که حاوی اعداد و یا حروف به صورت نامرتب و کج است Captcha نرم افزاری ست که با پرسیدن سوالاتی که جواب دادن به آنها توسط انسان راحت است می پردازد و به منظور حمله به این سیستم ها طراحی شده اند.Captcha در واقع یک مکانیزم امنیتی محسوب می شود که تعیین می کند که طرف مقابل شما یک کامپیوتر است یا یک انسان .لازم به ذکر است بدانیم که تست تورینگ توسط انسان برگزار می شود و هدفش تشخیص ماشین است اما کپچا توسط ماشین برگزار می شود و هدفش تضخیص انسان است. √ Captcha تصویری همراه با صدای تلفظ شده کاراکتر درون عکس √ Captcha ای که باید عکس موردنظر را در تصویر پیدا کرد

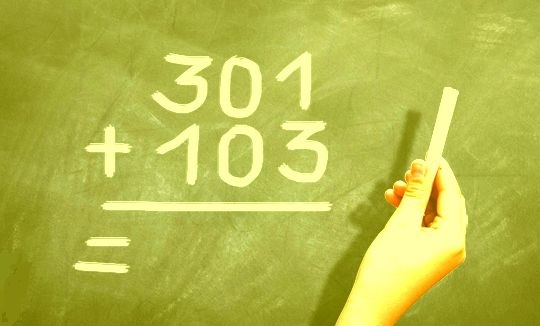

√ Captcha ای که باید که مسدله ی ریاضی ساده حل کرد

√ Captcha های سه بعدی

√ Captcha هایی با استفاده از تبلیغات

با استفاده از کپچا تنها انسان ها قادر به انتشار نظر در بخش وبلاگ سایت شما خواهند بود و به این ترتیب نیاز به عضویت در سایت یا وبلاگ شما برای جلوگیری از نظرات اسپم نیست. تصور می کنیم که شما 2 سایت طراحی کرده اید و هرکدام در دو زمینۀ متفاوت و مختص به خود مشغول به فعالیت هستند. یکی از این سایتها را 2 سال پیش طراحی نموده اید و در جریان این 2 سال فعال بوده است. و دیگری را حدود 1 ماه است که اجرا نموده و هر روز مطالبی تخصصی در آن درج می کنید. هیچ کدام از این 2 سایت سئو نشده اند. حال قصد دارید سایت شمارۀ 3 را در یکی از همان دو زمینۀ تخصصی راه اندازی کنید. اکنون این پرسش مطرح می شود: آیا باید سایت قدیمی را بهینه سازی و سئو کنید و یا از نو سایتی دیگر طراحی کنید و از همان ابتدا آن را سئو، بهینه سازی و اصولی نمایید؟ این پرسش مدت هاست در ذهن مدیران وبسایت هاست. ما در مثال بالا بهترین حالت ممکن را آوردیم. حالتی که سایت پیشین هم فعال بوده و تنها سئوی خاصی بر روی آن انجام نگرفته است. اکنون فرض کنید که سایت قدیمی با قدمت 2 ساله نه تنها سئوی مناسبی نداشته که محتوای تکراری و کپی درج نموده، دورۀ زمانی مشخصی برای به روزرسانی انجام نداده، و همچنین از ابزار وبمستر تولز نیز کوچکترین بهره ای نبرده تا آنالیزی هرچند کلی از تارنمای مربوطه داشته باشد.

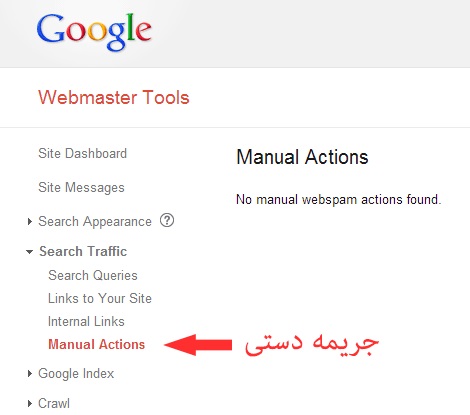

در ارتباط با مدل شمارۀ 1، پاسخ مورد نظر متفاوت با مدل شمارۀ 2 می باشد. از همین مثال دوم آغاز می کنیم: پاسخ کوتاه این است که سئوی تارنمای مذکور با توجه به عدم استفادۀ وبمستر آن از ابزار وبمستر تولز گوگل، اگر ناممکن نباشد به شدت غیر قابل پذیرش است که بتواند توجه ربات ها و صفحات نتایج جستجوی گوگل را به خود معطوف کند (آن هم با این ارفاق که از کنار لینک های جریمه شده بگذریم!). اما نشدنی هم نیست. این نشدنی نبودن به راحتی طراحی یک سایت جدید نیست و بسیار سخت خواهد بود. از موارد ساده ای که می توان به آن اشاره کرد، ثبت سایت در موتورهای جستجو، ثبت در وبمستر تولز گوگل و آنالیز کامل آن پس از حدود 1 ماه، تولید محتوای جدید، رفع خطاهای واکنش دستی و غیره! برای مشاوره و راهنمایی با کارشناسان ما تماس بگیرید! و اما مورد یکم که مرتبط با سایتی است که 2 سال فعالیت مداوم داشته، تولید محتوا نموده اما بر اساس اصول سئو حرکت نکرده است هرچند که اولین اصل سئو تولید محتوای جدید و غیر تکراری است. چنین سایتی با صرف زمان قابل توجهی به آسانی و البته با استفاده از متخصصین مجرب، امکان ارتقای پلکانی و حتا آنی را داشته و در جایگاه حقیقی خود در صفحات نتایج جستجوی گوگل قرار خواهد گرفت. خواه رتبۀ یکم و خواه رتبه دهم! از روش های موثر و آغازین سئوی یک سایت، ثبت آن در وبمستر گوگل، ارسال ربات های گوگل یا Crawlerها جهت بررسی تک تک لینک های تارنمای مورد نظر، کشف و اصلاح خطاهای سرور اعم از 404، 503 و امثالهم، یافتن Manual Actionها، ساختن بک لینک داخلی و ارسال و دریافت بک لینک حقیقی خارجی و مواردی از این دست می باشند.

توجه داشته باشید که سئو تنها محدود و منحصر به ایجاد چند لینک داخلی، یافتن و حذف و اصلاح نمودن لینک های تخریب شده و غیر قابل استفاده نیست. سئو شدن یک وبسایت نیازمند فردی متخصص در همین زمینه می باشد که به جای اصلاح، سایت را به اعماق جریمه ها و نابودی کامل آن نکشاند. بارها در سایر مقالات و کتب سئوی زیاد و عدم سپردن بهینه سازی سایت به دست افراد نابلد، طرح شده است. همانطور که برای هر آچاری که بر ماشین تان می کشید ارزش قائلید و نگران هستید، همان را به سطح سایت خود ارتقا داده و جلوی تخریب آن را نه تنها گرفته که به بهترین وجه ممکن کار رو تمام خواهیم نمود. توجه بفرمایید که در بسیاری از سرویس های وب نویسی، عدم ایجاد تغییرات در برخی از این سرویس ها به صورت هشدارگونه در ارتباط با فایلهایی چون robots.txt مطرح گشته است. در ارتباط با robots.txt بیشتر بخوانید. در مقاله وبمستر تولز به زبان ساده به طور کلی در ارتباط با بخش های مختلف وبمستر تولز توضیحاتی ارائه نمودیم. بخش Removal URLs

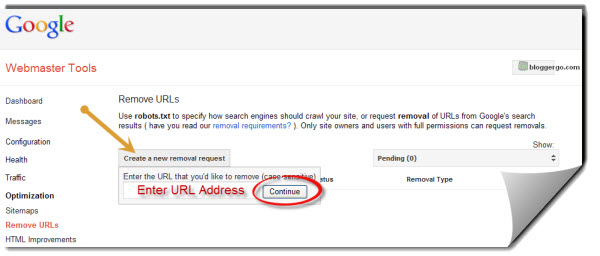

این ابزار را در بخش گوگل ایندکس در وبمستر تولز قرار داده اند. به این علت که یکی از پایه های اساسی سئو، حذف است. بله! همیشه تولید محتوای صرف، نمی تواند برای شما اعتبار بیاورد. گاها شما به حذف برخی از لینک های وبسایتتان نیز نیاز دارید. لازم است تا گرد و غبار کنید و کمی وبسایتتان را از کهنگی و اضافه باری که تنها ضرر دارند، در بیاورید. Removal URLs برای همین آمده است. این ابزار برای آن ساخته شده که شما بتوانید وب خود را از ایندکس هر نوع صفحه ای که خطاهایی نظیر 404، 503 و... دارد را معاف کرده و حتا نتایج پیشین را از گوگل حذف نمایید. زمانی که به این ابزار مراجعه می کنید و URLی را وارد می نمایید با 3 گزینه مواجه خواهید شد: (پیش از همه بدانید که باید وبسایت خود را از قبل در وبمستر تولز ثبت کرده باشید!) 1- Remove page from search results and cache: با انتخاب این گزینه نشانی صفحۀ URLتان را از صفحات نتایج جستجوی گوگل حذف کرده اید. با این روش شما به صفحات جستجوی گوگل می گویید که صفحه مورد نظرتان با اشکالاتی نظیر خطای 404 روبرو شده و دیگر در دسترس نیست. 2- Remove page from cache only: همانطور که مشخص است شما از ربات ایندکس کننده گوگل می خواهید که صفحۀ مورد نظرتان را از حافظۀ Cashe خود حذف کند. این انتخاب باعث این خواهد شد که ربات ایندکس کننده مجددا صفحه شما را ایندکس کرده و صفحۀ مذکور را دوباره بررسی کنند. 3- Remove directory: انتخابی است برای حذف کامل یک URL و تمامی زیر شاخه ها و ساب دامین های آن. به عبارتی وقتی که شما این عبارت را برای نشانی ای چون http://example.com می زنید، به صفحات جستجوی گوگل می گویید که تمام آنچه که در همین URL و سایر شاخه ها و زیر شاخه های آن موجود است را از نتایجش حذف نماید. چه زمانی نباید از ابزار Removal URLs استفاده کرد؟ 1- هر نوع فایلی که فکر می کنید بیهوده است را پاک نکنید. ما دوباره آن ها را ایندکس می کنیم. 2- خطاهایی که توسط خزندۀ گوگل شناسایی می شوند را از وبمسترتولز خود حذف نکنید. 3- اگر دومینی را از شخص دیگری به صورت دست دوم خریده اید و نگران این هستید که در هدف خزنده های ما باشند به ما اطلاع دهید. پیش از اطلاع دادن چیزی را حذف نکنید. 4- اگر سایتتان هک شده است تمام سایت را از پایه حذف نکنید. تنها به فایلهایی بسنده کنید که می دانید هکر مورد نظر آنها را در روت هاستتان ایجاد کرده است.برای مثال http://www.example.com/buy-cheap-cialis-skq3w598.html اما ما به هیچ عنوان پیشنهاد حذف کل سایت یا حتا لینک هایی را که می خواهید ایندکس شوند را نمی کنیم. امروزه دیگر اگرچه متخصصین حرفه ای سئو و بهینه سازی وبسایت همچنان فعال هستند اما به صورت مشخص چند ده فاکتور برای عیب یابی و پیشنهادات متفاوت به صورت ابزاری آنلاین وجود دارند که تقریبا ما را به صورت اتوماتیک هدایت، راهنمایی و از نیازمندی به متخصصینی صرفا سئوکار احتیاجی نیست چراکه ماشین ها این کارها را به خوبی انجام می دهند.

صحیح است که حتا سئوکاران از تمام این ابزار که در ادامه می آید برای ارتقای سئو و بهینه سازی وبسایت شما انجام می دهند اما با کمی دانش در این زمینه و مطالعۀ مرتبط با این رشتۀ تخصصی، تا حدود بسیار زیادی می توانیم متکی به همین دانش تحت وب باشیم. وبسایت Woorank.com

این وبسایت به شما اجازه می دهد در هفته، 1 وبسایت را از یک آی پی مشخص به طور رایگان آنالیز کرده و به طور کامل تمامی آنچه که برای سئو و بهینه سازی وبسایت خود نیاز دارید را بررسی و تحلیل کنید. این سایت به بهترین شیوه این کار را برای شما انجام خواهد داد. در صورت نیاز بیشتر می توانید عضو این سایت شوید و از همین خدمات بدون محدودیت تعداد وبسایت استفاده نمایید. همچنین با مراجعه به بخش تعرفه ها با 2 گروه از وبسایت ها مواجه خواهید شد. وبسایت های شرکتی، خبرگزاری ها و سایت هایی با ترافیک و حجم بالای اطلاعات؛ و سایتهایی در مقیاس کوچکتر همچون شرکت های خدماتی، سایتهای شخصی، سایت های اطلاع رسانی تخصصی و وبلاگها. که برای مورد اول می بایست 149 دلار و برای مورد دوم 49 دلار در ماه شارژ خواهید شد. همچنین وبلاگ وورنک اطلاعات به روز و مفیدی در زمینه های مارکتینگ، سئو و بلاگینگ در اختیار مخاطبان می گذارد.

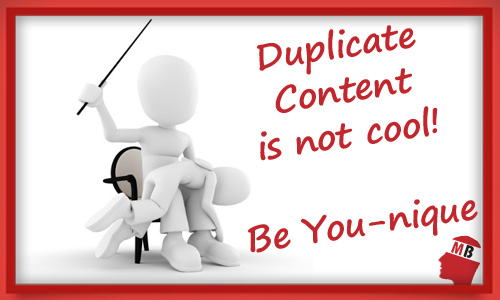

این وبسایت نیز به تازگی در میان بسیاری از وبمستران معروف شده است. اما آنالیزها نشان می دهد که تحلیل بسیار دقیقی ارائه نمی دهد هرچند که وبسایتی بسیار قدرتمند در نوع خود می باشد و منهای اینها، خدمات سئوی آن رایگان است. فاکتورهای اصلی اش در تعیین درصد سئو، تگ های h1, h2 و h3 می باشد. همچنین مواردی چون اعتبار کدنویسی در W3 را بررسی نموده و بر اساس آن نیز درصد مورد نظر را با ارائۀ راهنمایی هایی در زمینۀ بهتر نمودن شرایط سئوی سایت ارائه می کند. وبسایت SEOMoz از مشهورترین وبسایت های راهنما در زمینۀ سئو و بهینه سازی سایت. سئوموز که تحت فرمان رند فیکشن حرکت می کند. این وبسایت نیز به غیر از مقالات و راهنماهایی که به رایگان در اختیار مخاطبین می گذارد، یک دورۀ 30 نیز به عنوان پلان فروشی دارد که از آن طریق شما به خدمات بیشتر سئوموز دسترسی پیدا خواهید کرد. وبلاگ سئوموز تقریبا هر روز به روزرسانی می گردد. وبسایت SEO.com شعارش هست: اولین در بهینه سازی برای موتور جستجو! به صورت آنلاین هم در عرض چند ثانیه (گاهی تا 1 یا 2 دقیقه ممکن است طول بکشد) سایت شما را ارزیابی و سئو می کند و هم در همان لحظه راهنمایی های لازم را در باکس های چند خطی روبروی همان مورد مشخص می آورد. همانطور که در مقاله ی کدام را انتخاب کنیم: سئو یا بهینه سازی؟ گفته شد اولین اصل سئو تولید محتوای جدید و غیرتکراری است اما با وجود این اصل مطالب کپی زیادی در وب دیده می شود و همچنین روش های زیادی برای کپی مطالب از جمله استفاده از Feed و کپی مطالب به صورت مستقیم وجود دارد. خبرخوان و یا فید روشی ساده است که به شما این امکان را می دهد که به راحتی آخرین مطالب، اخبار ،عکس و یا هر اطلاعات دیگر را دریافت کنید و با استفاده از نرم افزار خبرخوان می توانید به راحتی آخرین مطالب سایت ها را ببینید.استفاده از هر دو روش کپی برداری مستقیم و خبرخوان می تواند موجب از دست دادن بخشی از کاربران سایت شما شود. برای جلوگیری از نمایش مطالب و عکس های خود در سایر وب سایت ها می توان از ویژگی Hot link استفاده کرد. Hotlink ها لینک های مستقیمی از domain شما به image ها یا فایل های multimedia از دیگر domain ها می باشند که اینکار می تواند موجب کاهش ترافیک سایت شما شود.برای جلوگیری از کپی تصاویر سایت خود می توان با استفاده از یک فایل بسیار کوچک به نام htaccess استفاده کرد.همچنین در صورتی که مایلید به جای تصاویر وب سایت شما که در سایر وب سایت ها لینک داده شده است یک تصویر جایگزین انتخاب کنید. با تکمیل فرم در سایت htaccesstools می توانید مانع کپی مطالب سایت خود شوید .حال به توضیح تیترهای این صفحه می پردازیم. Allowed Domain : در این بخش نام سایت یا سایت هایی که می خواهید دسترسی به تصاویر را داشته باشند معرفی کنید؛در این بخش نیاز به نوشتن www نیست. Allow Blank Referers : با توجه به اینکه تعدادی از افراد با استفاده فایروال های خاص امکان ردیابی و شناسایی محل ارجاع را به شما نمی دهند در این بخش میتوانید دسترسی این افراد به تصاویر را محدود کنید. توجه داشته باشید که با این کار کسانی که قصد کپی مطالب سایت را ندارند و با وارد کردن آدرس تصویر به صفحه آن میرسند نیز محدود میشوند. در مجموع پیشنهاد میکنیم که این گزینه را تغییر نداده و در حالت پیش فرض باقی بگذارید. Blocked Image URL : در این بخش می توانید از یک تصویر جایگزین هنگام کپی کردن تصاویر استفاده کنید باید توجه داشته باشید که این تصویر باید از دامنه ای باشد که اجازه استفاده از تصاویر را به دیگران بدهد. Files To Protect : این قسمت مخصوص پسوند فایل هایی است که میخواهید در کپی مطالب سایت و دامنه های خارجی نمایش داده نشوند می باشد. با فشردن کلید generate وارد صفحه ی دیگری میشوید که نشان می دهد کد موردنشر برای شما تولید شده است.با اضافه کردن این کد به htaccess در روت هاست خود اجازه کپی مطالب و تصاویر سایت را به دیگران نخواهید داد.بعد از انجام این مراحل با رجوع به سایت Test hotlink protection می توانید به تست کپی تصاویر خود بپردازید. شبکه های اجتماعی جدیدترین ابزار در بازاریابی اینترنتی هستند که به طور قابل توجهی باعث رشد سریع وبسایت ها می گردند. استفاده از این شبکه ها روز به روز در حال افزایش هستند و موفقیت و اعتبار شرکتها در استفاده از این سبک جدید تبلیغات به صورت بالقوه در حال رشد است.

اگر بخواهیم در یک جمله، سخن را خلاصه کنیم، می توانیم بگوییم که شبکه های اجتماعی، یک انقلاب هستند. چه وبسایت داشته باشید و چه نداشته باشید.

با حضور الگوریتم گوگل پاندا بود که قدم اصلی در حفظ و صیانت از حقوق تولیدکنندگان محتوا در اینترنت برداشته شد. سایت های اسپمینگ جریمه شدند و فرم هایی از جانب گوگل در اختیار تولیدکنندگان قرار گرفت که آنها نیز بتوانند اگر تخلفی از دید گوگل جا ماند، گزارش کنند و از طریق گزارش دستی، آن چند درصد جزیی خطا نیز برطرف گردد. به گوگل خوش آمدید... گوگل در این زمینه و در بخش "حقوق خصوصی و حفاظت از کپی رایت" میگوید:

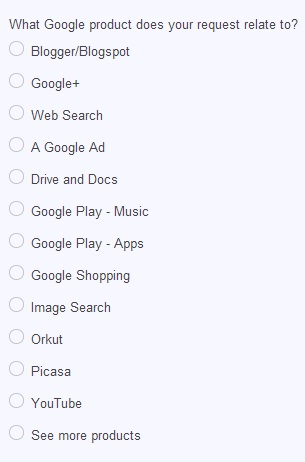

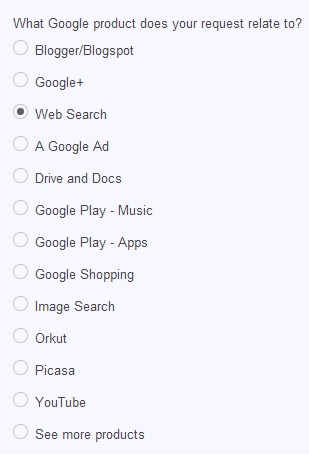

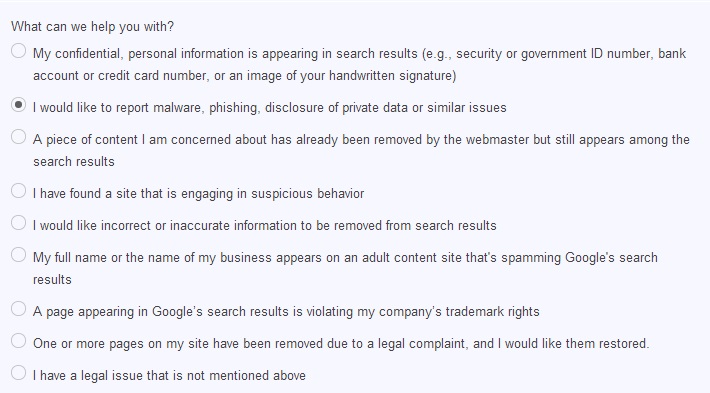

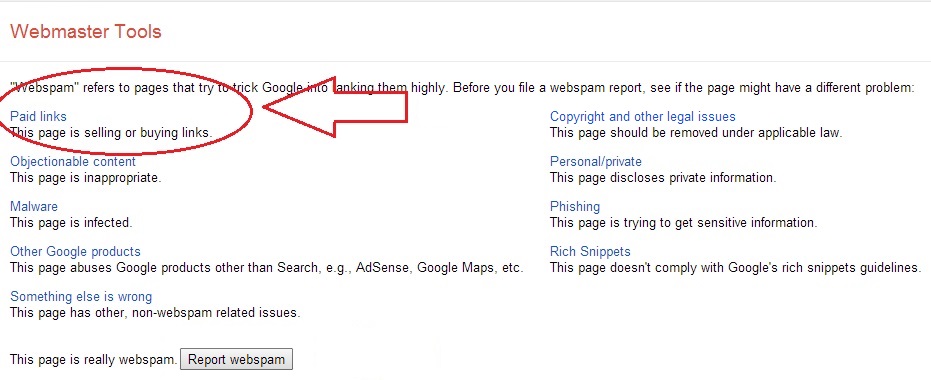

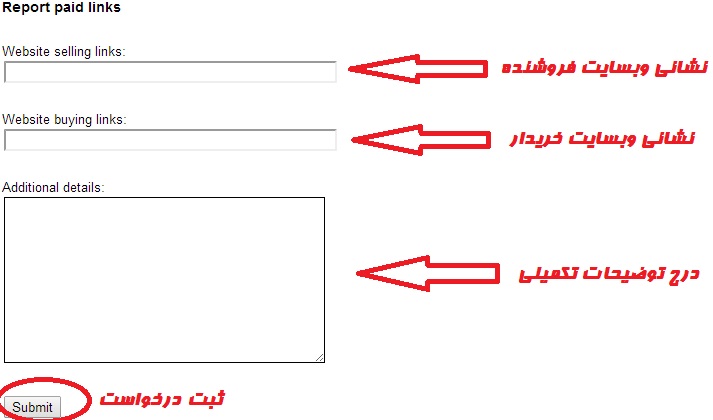

ثبت گزارش در هر یک از سرویس های گوگل، ممکن است جهت بررسی تا یک هفته نیز زمان ببرد و حتا پس از رسیدگی به شکایت شما، از طریق ایمیل، اس ام اس یا فکس مطلع نخواهید شد اما گوگل پس از تکمیل این فرم برای شما یک ایمیل تاییدیه ارسال می کند. شما خودتان باید روزانه بخش مورد شکایت را بررسی نمایید و رسیدن به حقوقتان را پیگیری کنید. همچنین برای پیشرفت وب فارسی و همچنین رشد بیشتر محتوا و عدم کپی برداری سایت های متقلب از سایرین، میتوانید با تکمیل این فرم در بخش جستجوی وب، گزارش مورد نظر را به گوگل بفرستید. این موضوع همچنین باعث خواهد شد که محتواهای مورد نظرتان را در چندین و چند سایت ندیده و هر روز شاهد محتوایی نو و جدید باشیم. مراحل ثبت یک گزارش خرید و فروش بک لینک غیر طبیعی به صورت تصویری:

ابتدا قبل از هر چیزی اگر اکانت در گوگل ندارید یکی بسازید.

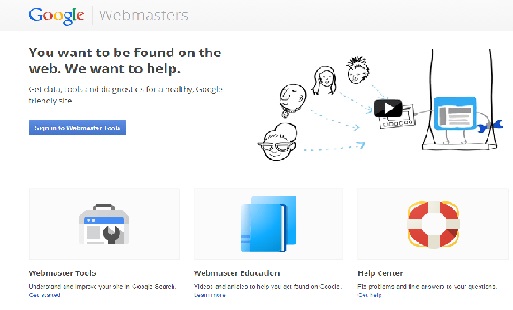

وارد صفحۀ وبمستر تولز گوگل بشوید و طبق دستورات زیر عمل کنید:

پس از ورود به این سرویس بر روی دکمه ...Add a site کلیک کنید در نوار کشوی که باز می شود آدرس وب سایت خورد را به صورت http://www.yoursite.com وارد کنید . و سپس دکمه Continue را جهت ثبت وب سایت کلیک کنید. حال آدرس سایت نمایش داده خواهد شد که نیاز به تایید دارد. برای تایید سایت بر روی گزینه Verify this site کلیک کنید تا وارد صفحه Verify ownership شوید در قسمت Verification method سه روش را در اختیار شما قرار میدهد تا به صورت دلخواه انتخاب کنید. روش اول اضافه کردن کد html به کدهای html سایت است مانند توضیحاتی که در بخش Show me an example آمده است. روش دوم اضافه کردن فایل html در روت وب سایت است ابتدا آن صفحه را دانلود میکنید و سپس در روت وب سایت آپلود میکنید. پس از آپلود باید بتوانید نشانی کامل فایل را که پس از آدرس دامنه تان می آید ببینید. (مثال: http://example.com/uvrjvrbrtbtsz2540ne524b242w5b4h523n4) روش سوم اضافه کردن کد به dns وب سایت است که البته دو روش اول ساده تر و کاربردی هستند. بعد انجام هریک از این روشها بر روی Verify کلیک کنید تا در صورت انجام درست مراحل وب سایت تائیید گردد. ورود بخش مدیریت یک وب سایت بر روی نام وب سایت مورد نظر که از قبل ثبت گریده کلیک کنید تا وارد بخش مدیریت آن شود.

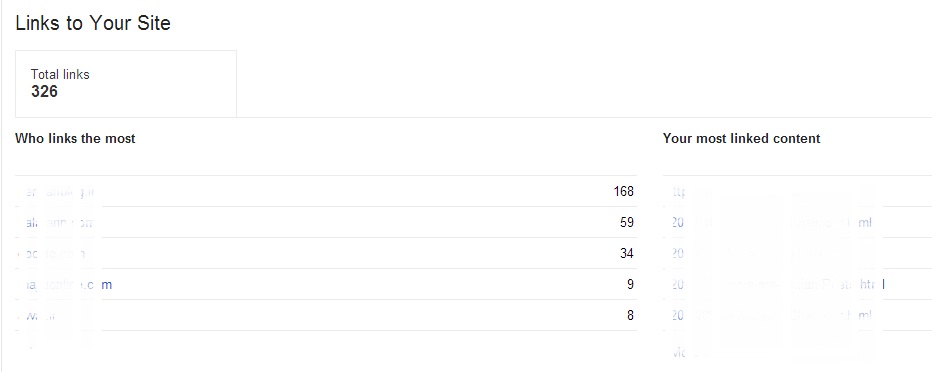

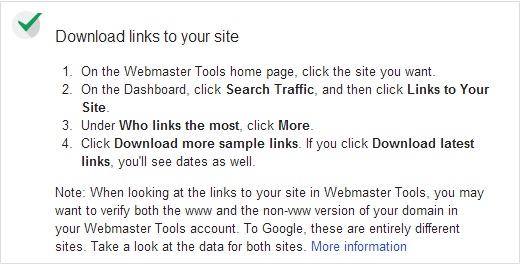

در این صفحه اطلاعات کلی از آخرین وضعیت سایت نمایش داده می شود.این اطلاعاتی در مورد وضعیت sitemap ها، وضعیت بازبینی سایت توسط موتور گوگل و وضعیت کلمات کلیدی جستجو شده برای ورود به سایتتان است. در منوی سمت چپ صفحه لیست کشوی می بینید که به وسیله آن به سایر قسمت های مدیریت دسترسی پیدا خواهید کرد. توضیحات منوی تنظیمات سایت Site configuration مدیریت Sitemap یا نقشه وب سایت، شما وقتی یک صفحه را در وب سایت خود می سازید می توانید با چند استاندارد آدرس این صفحات را به گوگل و سایر موتورهای جستجوگر معرفی کنید به مجموعه ای از این آدرس های که در قالبی خاص تعریف میگردند نقشه سایت یا سایت مپ میگویند. گوگل این امکان را می هد که نقشه سایت را به صورت استاندارد Feed "خوراک" و XML ثبت کنید. ثبت نقشه سایت در گوگل می تواند خیلی سریع تر صفحات وب سایت شما را در گوگل ذخیره کند و به دیگران این امکان را می دهد، آدرسهایی که ممکن است لینکی به آنها داده نشده باشه را پیدا کنند. همچنین تغییرات صفحات را خیلی سریعتر شناسایی خواهد کرد. استفاده از این سرویس خیلی موثر است پس از ثبت نقشه سایت می توانید در قسمت SITEMAP STATS مجموع صفحات وب سایت شما و میزان صفحات ذخیره شده در گوگل را نمایش می دهد. مدیریت دسترسی خزنده به قسمتهای سایت (Crawler access) برای جلوگیری از دیده شدن قسمت های از وب سایت مانند فولدرها و صفحات به دلایلی مانند جلوگیری از هک شدن وب سایت و همینطور عدم افشای بعضی از مطالب می توان از فایلی به نام robots.txt استفاده کرد که این فایل فرمت خاصی دارد که این امکان را می دهد که ربات های موتورهای جستجوگر را مدیریت کرد که به کدامیک از صفحات و فولدرها دسترسی داشته باشند. تمام موتور جستجو گر از این فایل پشتیبانی می کنند گوگل در این بخش این اجازه را می دهد که کنترل بیشتری بر روی دسترسی ها داشته باشید. امکان حذف آدرسها در تب Remove URL یکی از این موارد است همچنین در تب Generate robots.txt به تولید فایل robots.txt پرداخت و آن را در موتور های جستجوی مختلف گوگل مورد آزمایش قرار داد. مدیریت SiteLinks در صورتی که معماری سایت به درستی پیاده سازی شده باشد و دارای بازدیدکننده بالا و همچنین PageRank بالایی باشد در این صورت ممکن است که گوگل لینک ها یا به عبارتی منوهای وب سایت شما را به صورت خاص و تفکیک شده نمایش دهد که این امتیازی بسیار عالی از سوی گوگل به وب سایت شما میباشد. تنظیمات تغیر آدرس وب سایت Change of address اگر قصد تغییر آدرس دامنه وبسایتتان را دارید از این قسمت میتوانید برای مطلع کردن گوگل از این تغییر استفاده کنید تا با سرعت بیشتری صفحات جدید وب سایت شما را ذخیره کند. تنظیمات کلی (Settings) در صفحه تنظیمات اولین مورد Geographic target است که در این قسمت می توانید موقعیت جغرافیایی یا کشور هدف را انتخاب کنید. با این انتخاب سایت شما فقط در جستجو هایی که از آن کشور انجام می شود قرار خواهد گرفت. مورد دوم Preferred domain است که می توانید به گوگل بگویید آدرس سایت شما را با www نمایش بدهد یا نه و یا اینکه با توجه به لینک ها این کار را انجام دهد. مورد سوم تنظیم تعداد دفعات مراجعه خرنده گوگل به وب سایت در قسمت Crawl rate است. ممکن است که به علت بزرگ بودن سایت و مشکلات سرور نتوانید پاسخ گوی درخواستهای اضافی باشید که در این صورت این مقدار باید کم شود و در صورتی که از عدم شناسایی به موقع تغییرات وب سایت ناراضی هستید مقدار آن را افزایش دهید. توضیحات منوی Your site on the web کلمات کلیدی در جستجو نمایش داده شده search queries در این قسمت کلمات کلیدی که در موتور جستجوگر موجب مراجعه به سایت شما شده است به همراه موقعیت آن کلمات کلیدی از وب سایت شما در صفحات گوگل نمایش داده می شود. علاوه بر آن میزان کلیک ها و CTR ها را هم نمایش میدهد.گر کلمه کلیدی از وب سایت شما خیلی مهم واقع شود و آمار بازدید زیادی داشته باشد ستاره دار خواهد شد. با استفاده از این کلمات می توان نیاز کاربران را به درستی درک کرد و از این کلمات برای بهینه تر کردن وب سایت خود بهره ببرید و در صورت استفاده از تبلیغات کلیکی گوگل هدفمندتر به امر تبلیغات بپردازید. لینک ها به سایت شما Links to your site در این قسمت آدرس صفحاتی از وب سایت شما را که لینکهایی ارزشمند از سایت های دیگر به آن داده شده است لیست شده و نمایش داده میشود شما می توانید می توان متن لینکی که برای لینک دادن استفاده شده است و آدرس وب سایت های لینک دهنده را مشاهده کرد. از ویژگی برای بهینه کردن وب سایت و لینک های خارجی میتوان استفاده کرد.

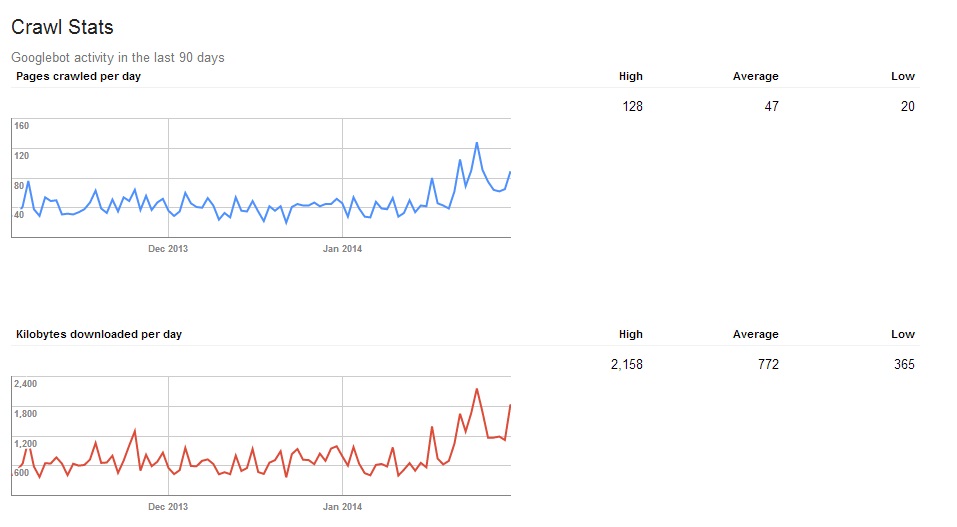

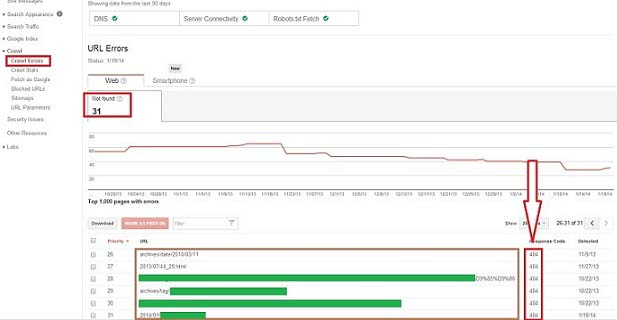

لینک های داخلی Internal Links لیست صفحاتی که در داخل سایت به یکدیگر لینک داده شده اند به همراه تعداد لینکها و صفحات لینک داده شده وجود دارد. توضیحات منوی امکانات عیب شناسی Diagnostics خطاهای خزنده Crawl errors در این قسمت خزنده یا همان ربات گوگل وقتی وارد سایت شما می شود تا اطلاعات آن را ارزیابی کند و با خود ببرد خطاهایی که در این هنگام کنکاش درون سایت مواجه می شود را نمایش میدهد. این خطاها به چهار دسته Web ،Mobile-Chtml ،Mobile-Xhtml تقسیم بندی گردیده است. اگر مشکلی در صفحات وب سایت شما رخ دهد گزارش کاملی در این قسمت در اختیار شماست و این گزارشات را جدی بگیرید ! چون حساسیت گوگل به این خطاها بالاست. در قسمت "Restricted by robots.txt" لیست صفحاتی که توسط robot.txt پاک گردیده اند را نمایش میدهد. گزارش وضعیت خزنده Crawl stats در این صفحه شما گزارشی از وضعیت صفحات کنکاش شده توسط خزنده یا همان ربات موتور جستجوگر بر روی سایت را دارید که شامل صفحات کنکاش شده درهرروز ،میانگین مدت زمان صرف شده برای دریافت صفحات ، کیلوبایت صفحات دانلود شده در هر روز است.

پیشنهادهای کدهای اچ تی ام ال HTML suggestions در این قسمت هنگامی خزنده سایت به سایت شما مراجعه میکند اگر مسئله ی را با محتوایی صفحات سایت شما بیابد به صورت لیست از صفحات که دارای مشکل هستند را ارائه میدهد که حل این ریز مشکلات موجود در صفحات کمک بسزای در ذخیره کردن صفحات شما در موتور جستجوگر خواهد نمود. این بخش شامل سه قسمت است که هر قسمت خود شامل سه مورد Duplicate meta , Long meta , Short meta است: قسمت اول Meta description می باشد که اگر توضیحاتی تکراری در صفحات وب سایت داشته باشید در Duplicate meta description نمایش داده خواهد شد و اگر توضیحات صفحاتان بلندتر از حد مجاز باشد در Long meta descriptions نمایش داده خواهد شد که باید کوتاه تر گردند و اگر توضیحات صفحاتتان کوتاه باشد در Short meta descriptions نمایش داده خواهد شد که باید بلندتر گردند. سایر قسمت ها نیز به همین صورت میباشند. با توجه به تعدد پرسشهای کاربران محترم، امروز مقاله ای را تحت عنوان ذکر شده خدمتتان ارائه می کنیم.

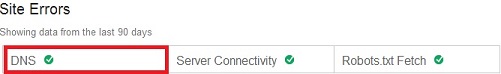

دلایل زیادی وجود دارد که دسترسی ربات گوگل به صفحات و یا کل یک سایت محدود و یا کاملا قطع شده باشد. یکی از این دلایل می تواند تنظیمات DNS دامین یا ایجاد مشکلاتی در سرور سایت باشد. این قبیل اتفاقات میتواند به Seoی سایت شما آسیب بزند و در موارد بسیاری، موتور جستجوگر و ربات گوگل نتواند صفحات سایت را ایندکس کند. گوگل محتوای مختلف را از طریق لینک های یک صفحه به صفحۀ دیگر پیدا میکند. عموما یک پیام خطای "یافت نشد" (معمولا یک پیام با کد HTTP 404) زمانیکه گوگل تلاش می کند تا صفحه ای را ایندکس کند، و صفحۀ سایت به ربات جستجوگر برگشت میزند نمایش داده می شود، چراکه در هر صورت شما یا لینکی را پاک نموده و یا بدون جهت دادن به صفحه ای جدید تغییر نام داده اید. شاید هم به خاطر اینکه در تایپ لینک مورد نظر خطا داشته اید!

تقریبا یک ماه دیگر می شود یک سال از زمانیکه شاهد آخرین آپدیت تولبار پیج رنک گوگل بودیم. + +

با گسترش تلفن های همراه هوشمند در بازار، این بازار سهم بیشتری را اکنون به خود اختصاص داده است. حالا این بسیار مهم است که وبسایتها یک نسخۀ موبایل هم برای صفحاتشان داشته باشند؛ یک نسخۀ خاص که صفحاتش کوچکتر و سریع لود شود. همچنین جایگزینی پاسخگو برای کاربران تلفن همراه در مقابل نسخههای سنتی و قدیمی باشد.

آیا در چشمان گوگل، تفاوتی میان طراحی واکنشگرا و نسخ قدیمی موبایل سایتها وجود دارد و در سئو موثر است؟ خوشبختانه بله! مهندس ارشد گوگل -مت کاتس- در یک ویدیویی که از وی منتشر شده، نگاهی به این موضوع داشته است. در ابتدا، بسیاری از مردم میپرسند که اصولا طراحی واکنشگرا چیست. خب این یک موضوع کمابیش جدید است و حتا بسیاری از وبمستران اطلاعات دقیقی از این نوع طراحی ندارند. به گفتۀ مت کاتس "طراحی واکنشگرا تنها بدین معنی است که همانطور که یک سایت با یک مرورگر دسکتاپی (کامپیوتری) کار میکنند، همانطور میتوانید به نسخۀ موبایل دسترسی داشته باشید. تنها، صفحات و همه آنچه که در وب میبینید تغییر سایز داده و سایز صفحه بر اساس صفحۀ مانیتور تلفن هوشمند شما تغییر خواهد کرد. اما کدام؟ طراحی واکنش گرا یا موبایل سایت؟ قطعا این دو برای گوگل متفاوت است و جستجوگر آن نیز نسخه های واکنشگرا (قالب بندی با صفحۀ دسکتاپ، موبایل هوشمند و تبلت ها) را به نسخه های موبایل سایت، تبلت سایت و نسخه های دسکتاپی بیشتر ترجیح میدهد. به معنای دیگر ، هرچه وبسایت و محتوای شما به صورت بهینه برای دستگاه های موبایل طراحی شده باشد، رتبه بالاتری برای کاربران آن دستگاه دارد. این موضوع به خوبی حس می شود که نمایش سایت های بهینه نشده و ضعیف در دستگاه های موبایل پارامتر مناسبی برای گوگل محسوب نمیشود. برای ایجاد یک سایت واکنشگرا، نیاز است تا با داشتن دانش کدنویسی CSS تنها با چند خط کد، سایت خود را واکنشگرا نمایید. چراکه تفاوتی میان کدنویسی میان سایتهای دسکتاپی با سایتهای واکنشگرا نیست و با یک نوع کد نوشته میشوند. تنها باید مسیر جستجو و خزیدن رباتهای گوگل را برای سایت واکنشگرای خود باز بگذارید. برای انجام این امر نیاز است تا محدود کننده های فایل Robots.txt را از میان برداشته و کدهای مورد نظر را در قالب سایت بگنجانید تا رباتها ضمن جستجوی بدون محدودیت در میان سایت شما، به راحتی سایت اصلی را از سایت واکنشگرا تشخیص دهند. هنوز فکر می کنید وقت سئو و بهینه سازی وبسایت برای تلفن های هوشمند نرسیده است؟ ماه گذشته، گوگل با ایجاد نمودن فرمی در گوگل داکس، از کسانی که فکر می کنند ممکن است یک سایت خاص و مورد نظر ایشان، از توجه گوگل دور مانده و جایگاه مناسبی در جستجو نیافته، درخواست کرد که در این فرم، کاربران با درج نام سایت (نام دامنه) و توضیحی در این ارتباط که چرا شما فکر می کنید این سایت جایگاه مناسبی ندارد، درج نمایند و گوگل آن را بررسی خواهد کرد،در این مقاله می خواهیم تا به نگاه گوگل به تعداد صفحات سایت بپردازیم.

وی در این ویدیو می گوید که زمانی که صفحات سایتتان را افزایش می دهید، این شانس را دارید که کلمات کلیدی بیشتری نیز استفاده کنید و برای کلمات کلیدی بیشتری، مطالب را سئو کنید. چراکه در حالت عادی امکان درج بیش از دو یا سه کلمۀ کلیدی اصلی نیست. این "نبودن" به معنای امکان نداشتن و ممنوع بودن نیست. بدین معنی است که نمی توان برای یک صفحه بیش از دو یا سه کلمه کلیدی را متصور شد. مطلب بعد در ارتباط با سایتهایی با صفحات بالاست. این نوع سایتها به دو دسته تقسیم می گردند؛ یا سایتهایی که مطالبشان را مستقیما از صفحات دیگر کپی می کنند و یا سایتهایی با صفحات بالا و نسبتا بالا که خود تولید کنندۀ محتوا و مطالب مفید هستند. این سایتها شانس زیادی برای دریافت بک لینک های واقعی و معرفی از جانب سایت های دیگر خواهند داشت که به اعتبار و کسب جایگاه بهتر در نتایج گوگل کمک زیادی خواهد کرد. همچنین افزایش بک لینک حقیقی، شانس ورود روبات های گوگل به سایت شما و ایندکس نمودن صفحاتتان را بالا خواهد برد. متاتگ از اهمیت بالای برخوردار است و اطلاعات وب را به مرورگر یا موتور گوگل معرفی می کند به عبارتی محتوای توضیحات متا در نتایج جستجوی گوگل قابل رویت می باشد و زمانیکه سایت شما در میان صفحات بسیار دیگری در گوگل به کاربران اینترنتی نشان داده می شود،تنها توضیحات متا و عنوان صفحه قابل رویت است و همین دو عامل است که به کاربران در انتخاب بهترین نتیجه کمک می کند.

از آنجاییکه متاتگ از چشم بازدیدکننده پنهان است بیشتر در جهت بهینه سازی سایت کاربرد دارد و استفاده صحیح از آن می تواند در رتبه بندی گوگل موثر باشد. بسیاری از ادمین ها و بلاگرها تصور می کنند که اگر یک متنی تولید کردند، برای آنکه متنشان توسط افراد بیشتری خوانده شود و ربات های جستجوگر گوگل را بیشتر جذب کنند، آن را در چندین نشانی دیگر کپی می کنند. حال آنکه امروزه باید بدانیم که حتا نشانی هایی که بعضا با www و همچنین بدون این 3 حرف، فعال هستند نیز در خطر جدی ایندکس نشدن و جریمه شدن هستند. گوگل سخت تلاش می کند تا صفحاتی با اطلاعات متمایز از سایر صفحات وب، ایندکس کند و نشان دهد. گوگل چندین راه برای پیشگیری از ایجاد لینکهای تکراری و همچنین راههایی جهت نشان دادن آنچه که شما می خواهید برایتان ایندکس شود را پیش پایتان می گذارد:

در موارد نادر، الگوریتم گوگل ممکن است یک URLی را از یک سایت انتخاب کند که در حال انتشار مطلب شما بدون اجازه تان است. اگر شما معتقدید که آن سایت در حالت کپی برداری مطلب شما بدون رعایت قوانین کپی رایت است، احتمالا باید با هاست سایت مربوطه تماس بگیرید و درخواست حذفش را بدهید. به علاوه، می توانید درخواست حذف آن صفحۀ خاص را از طریق صفحۀ "درخواست تکمیل فرم مخصوص به قوانین نقض شده" به گوگل بفرستید.

برویم سر بحث اصلی! گوگل و رباتهای جستجوگرش پس ارائۀ الگوریتم مرغ مگس خوار، دقت فراوانی در گشتن به دنبال اولین صفحه ای هستند که با توجه به زمان و تاریخ ایندکس شدن، مطلب را درج کرده است و باقی صفحات را از بخش نتایج جستجو حذف خواهند کرد. البته در صورت درخواست کاربر، گوگل می تواند صفحات تکراری را نیز نشان دهد اما در حالت عادی این صفحات برای گوگل فاقد ارزش و محتوا هستند. توضیحات در ارتباط با هر بخش وبمسترتولز، هرچقدر آسان و کاربردی اما به همان میزان ممکن است کمی پیچیده باشد چراکه هر چند وقت یک بار، گوگل ابزار جدیدی را به این قسمت اضافه می کند. طوری که کاربر فکر می کند حتما چنین چیزی را نیاز داشته و می بایست از مدت ها پیش این ابزار خاص به زیرمنوهای یکی از قسمت های وبمسترتولز اضافه می گشت. اما این بار تقریبا وبمسترتولز سر ناسازگاری عجیب و شگفت انگیزی با وبمستران برداشته است: واکنش یا جریمه دستی! به توضیحاتی در این مورد توجه کنید. اینکه مدیران بخش مبارزه با اسپم گوگل چه می کنند و وبمستران باید چه کنند تا با واکنش دستی گوگل مواجه نشوند! ولی پیش از این موضوع به مطلبی دیگر اشاره می کنیم تا بدانید واکنش دستی چیست و در کجا از آن استفاده می شود! اطلاعات ما برگرفته از توضیحات بخش Support گوگل و مقالۀ Image Mismatch میباشد. Image Mismatch (عدم همخوانی یا تطابق تصویر): اگر این پیام را در صفحۀ واکنش دستی میبینید، بدین معناست که برخی از تصاویر سایت شما ممکن است به صورت متفاوتی در صفحات نتایج جستجوی گوگل با زمانیکه در سایت خودتان نمایش داده می شوند وجود داشته باشد. در نتیجه، گوگل یک واکنش دستی را در بخش های این چنینی سایتتان ثبت کرده است که باعث می شود بدانید که تصاویرتان چگونه در گوگل نمایش داده شده اند. اطلاعات مربوط به این اتفاق به صورت کامل در لیستی زیر تطابقات وسیع سایت (site-wide matches) آورده شده اند. همچنین اتفاقاتی نظیر این اگر تنها در بخشی از سایت رخ داده باشد می توانید اطلاعات مربوط به آن را نیز به صورت لیست شده و تحت نام تطابقات کوچک (partial matches) مشاهده نمایید. پیشنهادهایی برای بهتر شدن

زمانیکه اقدامات ثبتی و درخواست تجدید نظر را انجام دادید، گوش به زنگ و منتظر یک پیام در اکانت وبمسترتولز خود باشید. ما پس از بازبینی سایت، شما را در جریان خواهیم گذاشت. در صورتیکه محرز گردد که بر اساس راهنمایی های انجام شده، دیگر مواردی را نقض نمی کنید، واکنش دستی را منتفی خواهیم کرد. و اما واکنش دستی کجاست و چه می کند؟ درحالیکه گوگل مشغول اقدامات لازم بر روی الگوریتم هایش جهت ارزیابی و بهبود مداوم کیفیت جستجو است، ما هم بخشی را با عنوان واکنش دستی که از تکنولوژی ضد اسپمینگ استفاده می کند بر روی سایت ها آورده ایم. این بدین معناست که بخش واکنش دستی بر خلاف بخش های دیگر گوگل که ربات ها بسیار فعالند، در اینجا نیروی انسانی و کارمندان بخش مبارزه با اسپم کار و این بخش را کنترل می کنند. صفحۀ واکنش های دستی اقداماتی از این دست را بر عهده دارد (و البته اقدامات امنیتی دیگر) و به قسمت هایی که از نظر گوگل دچار مساله هستند لینکهایی جهت بررسی و رفع مساله توسط ادمین سایت می دهند. (اگر رنکینگ سایت شما تحت تاثیر فشارهای بخش واکنش دستی قرار گرفت، ما این موضوع را در مرکز پیام خودتان در وبمسترتولز اعلام خواهیم کرد)

اگر سایت شما در نتایج جستجو دیده نمی شود، یا آنطور که پیشتر اجرا می شد، اکنون نمی شود، پیشنهاد می کنیم سری به صفحۀ واکنش دستی خود بزنید تا به نشانی های مشکل دار برسید و در جهت رفعشان اقدام کنید. زمانیکه شما از عملکرد سایتتان در قبال راهنمایی های ما مطمئن شدید، می توانید درخواست یک بازبینی از سایتتان را به صورت مستقیم از صفحه واکنش دستی تان ثبت نمایید. دنیای وب یک دنیای اکوسیستمی است که هر لحظه در حال تغییر است؛ و عملکرد سایت شما هم به عنوان جزیی از دنیای وب در جستجو، تقریبا به طور قطع در گذر زمان در حال نوسان است. بر این اساس حتا اگر درخواست تجدید نظر شما موفقیت آمیز باشد، رنک سایت شما ممکن است به پایینتر (یا بالاتر) از چیزی که قبلا بود برسد. مروری بر صفحه واکنش دستی 1. در داشبورد وبمسترتولز، روی Search Traffic کلیک کنید. 2. بر روی Manual Actions کلیک کنید. 3. واکنش های دستی لیست شده را در این بخش مرور کنید. هنگامی که مشکلات لیست شده را رفع کردید و اطمینان حاصل نمودید که سایتتان از راهنمای وبمستر (Webmaster Guidlines) پیروی می کند، بر روی Request a review کلیک کنید تا از گوگل درخواست تجدیدنظر سایت شما را ثبت نمایید. دو بخش مهم در صفحه واکنش دستی وجود دارد:

هر بخش شامل اطلاعات زیر می شود: Reason: دلیل هر خطا و اقدامی که گوگل کشف می کند. Affect: قسمتی از سایت را نشان می دهد که واکنش دستی را حساس و جلب توجه کرده است. اگر یک واکنش دستی بیش از 1000 آدرس را زیر ذره بین بگیرد، تنها 1000 نشانی اول نمایش داده می شوند. در مورد گوگل و اسپم الگوریتم گوگل بسیار خوب در تشخیص اسپم ها عمل می کند و در بیشتر موارد، به صورت اتوماتیک آن را کشف و از نتایج جستجو حذف می کند. به هر حال جهت حفاظت از ایندکس ها، گوگل اراده ای قوی در این موضوع دارد و به همین خاطر بخش واکنش دستی را جهت حذف اسپم و اسپمینگ از نتایج جستجویش ایجاد نمود. همانطور که میدانید گوگل در طی چندین سال به طور مرتب تقریبا هر سه ماه یکبار پیج رنک صفحات را آپدیت می کرد و این پیج رنک یکی از فاکتورهای مهم در تعداد ورودی گوگل و نشان دادن یا ندادن هر سایت در صفحات اول نتایج گوگل بود. اما مدتی ست که از بروزرسانی مجدد گوگل گذشته است و تلاش افرادی که در بروزرسانی سایت خود اقدام کرده اند بی نتیجه مانده است.در اینجا می خواهیم تا به سرانجام پیج رنک گوگل پی ببریم.

مت کاتس در صحبت هایی در مورد پیج رنک گوگل به سرانجام پیج رنک گوگل اشاره کرده است. بر اساس گفته ی مت کاتس که در مورد عدم بروز رسانی پیج رنک گفته شده، ایده حذف پیج رنک را در ذهن تقویت می کند. همچنین مت کاتس اشاره میکند که پیج رنک یک سایت نشانگر کیفیت محتوای آن نیست با اینکه بر رتبه بندی نتایج گوگل تاثیر گذار است. به گفته او پیج رنک تنها نشان دهنده تعداد لینک های ورودی به یک سایت از سایت های دیگر اینترنت است. عوامل موثر در پیج رنک به عبارتی یکی از عواملی که می تواند در پیچ رنک موثر باشد ساختار و کیفیت کدنویسی می باشد و سایت باید یک صفحه اصلی داشته باشد و به راحتی بتوان به صفحات مهمتر دسترسی پیدا کرد (مانند نمودار درختی). اینکار موجب می شود تا پیج رنک سایت شما افزایش پیدا کند. همچنین برای بهبود جایگاه خود در موتورهای جستجوگر گوگل استفاده از محتوای مفید و با کیفیت از اهمیت بالایی برخوردار است. و در آخر با توجه به صحبت های مت کاتس می توان متوجه شد که مفهوم پیج رنک بصورت یک عدد مشخص تا حدی فراموش شده و به کاربران اینترنتی ارائه نخواهد شد ولی ارزش و اهمیت کسب بک لینک های طبیعی و مناسب از سایت های معتبر همچنان حفظ شده و بر رتبه بندی نتایج جستجو تاثیرگذار است. هنگام طراحی وب سایت اولین موضوعی که افراد با آن روبرو می شوند هاست و همچنین دامنه ی سایت می باشد.از آنجاییکه امروزه یکسری تبلیغات درباره ی خرید دامنه با رنک 2 و 3 مطرح شده است در اینجا می خواهیم تا درباره ی نکاتی که قبل از خرید دامنه دست دوم باید بدانیم اشاره کنیم.

اولین نکته ای که در خرید دامنه دست دوم باید بدانیم لینک هایی که قبلا در این دامنه بوده مرتبط با سایت فعلی شما می باشد یا خیر. برای راحتتر کردن مفهوم به مثال روبرو توجه کنید.کسی که در فکر راه اندازی یک فروشگاه لوازم ورزشی است هیچگاه فروشگاه خود را در جایی که فروشگاه های لوازم خانگی هستند احداث نمی کند.دامنه ها نیز همینطورند به عبارتی دامنه ی دست دوم هم می تواند موجب سرعت بخشیدن پیشرفت وب سایت شما شود هم مانعی برای پیشرفت سایت. مت کاتس در رابطه با دامنه های رنک دار قدیمی می گوید:زمانیکه شما یک دامنه استفاده شده را خریداری میکنید و با مشکلاتی روبرو میشوید به این معنی است که قبلا شخصی بر روی آن فعالیت های مغایر با قوانین گوگل یا اسپم انجام داده است. با توجه به گفته ی کاتس متوجه می شویم که یک دامنه ی دست دوم می تواند جریمه هایی را داشته باشد که بعدها برای شما مضر باشد و واضح است کسی که روی سایت خود کار کرده باشد و دارای رنک بالایی باشد حاضر به فروش دامنه خود نخواهد بود! به هر دلیلی اگر تمایل به خرید دامنه دست دوم داشته باشید می توانید با ساختن یک اکانت در وبمستر گوگل وارد بخش Manual Actions رفته و جریمه های آن را ببینید.همچنین می توانید زمینه ی کاری سایت ها را برررسی کنید،حتی اگر محتوایی روی دامنه رنک دار قرار دارد از چه کیفیتی برخوردار است. لازم به ذکر است که با استفاده از تکنیکهایی می توان رنک بالا بدست آورد اما با عوض شدن آپدیت بعدی گوگل از بین خواهد رفت. در پایان می توان گفت که خرید یک دامنه رنک دار می تواند یک ریسک باشد و باعث سرعت در پیشرفت و یا شکست سایت شما شود. بنابراین بهترین روش برای پیروزی در سایت استفاده از مطالب بکر و ایده های تازه است همچنین بررسی رفتار بازدیدکنندگان و شناسایی صفحات پربازدید سایت راهنمای مناسبی برای تعیین ادامه مسیر سایت و جهت گیری مطالب خواهد بود. هر روزه گوگل به بیش از 1 بیلیون (یک میلیارد) جستجوی مردم در سراسر جهان شامل 181 کشور و 146 زبان را پاسخ میدهد.

15 درصد از جستجویهایی که هر روز با آن مواجه میشویم را پیشتر ندیدهایم. چنین چیزی را تکنولوژی میسر میکند چراکه ما (گوگل) برنامههای محاسباتی ای را خلق میکنیم که به آن “الگوریتم” میگویند که میتواند به حجم و وسعت بسیار بالایی از درخواستهای جستجو پاسخگو باشد.در اینجا می خواهیم تا شما را با الگوریتم گوگل در نحوۀ ارائۀ موتور جستجو آشنا کنیم.

ما (به عنوان گوگل) تازه در ابتدای چیزی هستیم که امکان پذیر است و به طور مداوم در حال یافتن راه حلهای بهتری هستیم. تعداد مهندسین بیشتری داریم که در حال کار بر روی سیستم جستجویی هستند تا آنچه که امروز موتور جستجوی گوگل ارائه میکند متفاوت تر از هر زمان دیگری در گذشته باشد. تکیۀ موتور جستجوی گوگل بر نبوغ انسانی، تداوم و سماجت و همچنین سخت کار کردن است. به عنوان یکی از مهندسین و طراحان این موتور، چیزی را طراحی میکنیم که یک گشتاور خوب، با بهره وری و مقاومت، پر صدا و سایر کیفیتها داشته باشیم. مهندسین بخش جستجوی گوگل الگوریتمی را طراحی میکنند که با سرعت بازگشت به موقع ربات جستجوگر، با کیفیت، متمرکز و پاسخگوی جستجوهای مردم باشد.

درباره وبلاگ به وبلاگ من خوش آمدید آخرین مطالب آرشيو وبلاگ نويسندگان پيوندها |

|||

|

|